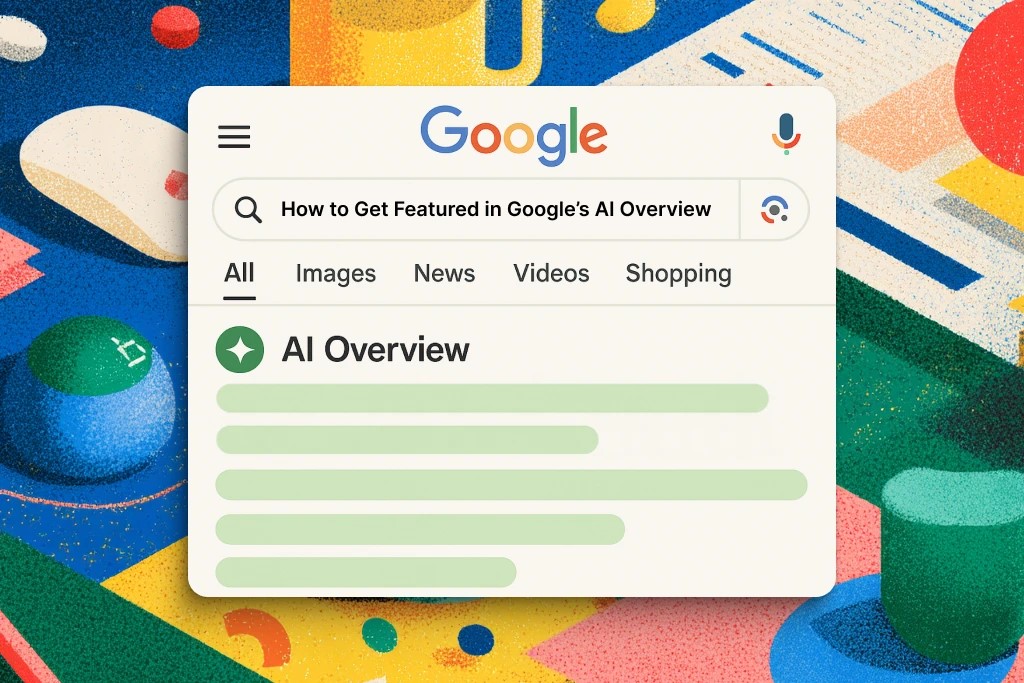

Google AI Overview

Google’ın yapay zekâ destekli arama sonuçlarında ortaya çıkan hatalı içerikler, kullanıcı güveni açısından önemli bir tartışma konusu haline gelmiş durumda. Uzmanlar, sistem tarafından oluşturulan özetlerin bazı durumlarda güvenilir kaynaklarla çeliştiğini ve bu yapının yanlış yönlendirmelere açık olabileceğini ifade ediyor. Bu nedenle, yapay zekâ tabanlı arama sonuçlarının daha şeffaf ve doğrulanabilir hale getirilmesi gerektiği vurgulanıyor.

Google’ın yapay zekâ destekli arama özetleri, yüksek doğruluk oranlarına ulaşmasına rağmen, milyarlarca sorgunun işlendiği sistemde her gün milyonlarca hatalı yanıtın ortaya çıkmasına neden olabiliyor. Bağımsız testler, doğruluk oranının Ekim ayında yüzde 85 seviyesindeyken Şubat ayında Gemini 3 ile yüzde 91’e yükseldiğini gösteriyor. Ancak bu küçük hata payı bile ölçek büyüdüğünde ciddi bir soruna dönüşerek saat başına yaklaşık 57 milyon yanlış bilginin üretilmesine yol açıyor.

Bu tablo, bilgiye erişimde güvenilirlik konusunu yeniden gündeme taşıyor. Uzmanlar, yapay zekâ tarafından oluşturulan özetlerin zaman zaman kaynaklarla çelişebildiğini ve bunun kullanıcıları yanlış yönlendirebileceğini belirtiyor. Ayrıca sistemin aynı soruya kısa süre içinde farklı cevaplar verebilmesi, yapay zekâ modellerinde hâlâ istikrar ve tutarlılık sorunları bulunduğunu ortaya koyuyor. Bu nedenle, teknoloji dünyasında yapay zekâ destekli arama sistemlerinin daha şeffaf, denetlenebilir ve güvenilir hale getirilmesi gerektiği vurgulanıyor.

Algoritma hataları bariz belli

Yapay zekâ girişimi Oumi’nin analizleri, Google’ın yapay zekâ destekli arama sistemindeki hata payını daha somut verilerle ortaya koyuyor. 4 binden fazla sorgu üzerinden yapılan incelemeler, sistemin zaman zaman yanıltıcı sonuçlar üretebildiğini gösterirken, Google yetkilileri bu testlerin gerçek kullanıcı davranışlarını tam yansıtmadığını savunuyor. Buna rağmen, şirketin kendi iç değerlendirmelerinde Gemini 3 modelinin arama motorundan bağımsız çalıştığında yaklaşık yüzde 28 oranında “AI hallucination” yani hatalı veya uydurma bilgi üretme eğilimi sergilediği kabul ediliyor.

Yılda yaklaşık 5 trilyon aramanın gerçekleştirildiği bu devasa dijital ortamda, düşük görünen hata oranları bile ciddi sonuçlar doğurabiliyor. Örneğin yüzde 10’luk bir hata payı, dakikada yaklaşık 1 milyon yanlış bilginin kullanıcıların karşısına çıkması anlamına geliyor. Bu durum, özellikle doğru bilgiye hızlı erişimin kritik olduğu günümüzde, güvenilirlik tartışmalarını daha da artırıyor.

Google, arama motoru güvenilirliğini korumaya yönelik çalışmalarını sürdürse de, yapay zekâ tarafından oluşturulan özetlerle bu özetlerin dayandırıldığı kaynaklar arasındaki uyumsuzluk dikkat çekiyor. Uzmanlar, bu tutarsızlıkların yapay zekâ teknolojilerinin hâlâ gelişim sürecinde olduğunu ve bilgi doğrulama konusunda daha fazla iyileştirmeye ihtiyaç duyulduğunu ortaya koyduğunu belirtiyor.

Google AI Overview özetlerinin altında yer alan kaynak bağlantıları, çoğu zaman verilen bilgileri doğrulamakta yetersiz kalıyor ve bazı durumlarda tamamen alakasız sayfalara yönlendirebiliyor. Yapılan araştırmalar, kasıtlı olarak yayılan yanlış bilgilerin kısa sürede sistem tarafından doğruymuş gibi sunulabildiğini ortaya koyarken, bu durum yapay zekâ destekli arama sonuçlarının manipülasyona açık olduğunu gösteriyor. Özellikle doğru bir özetin yanlış bir kaynağa dayandırılması ya da hatalı bir bilginin yanında güvenilir bir linkin verilmesi, kullanıcıların bilgi kirliliği içinde doğruyu ayırt etmesini zorlaştırıyor. Bu nedenle yapay zekâ tabanlı arama sonuçları, özellikle akademik ve profesyonel araştırmalarda dikkatli kullanılması gereken bir araç olarak öne çıkıyor.

Teknoloji şirketleri ise bu risklere karşı sorumluluğu büyük ölçüde kullanıcıya bırakıyor. Hizmet şartlarında yer alan uyarılarla, sunulan bilgilerin hatalı olabileceği açıkça belirtiliyor. Microsoft yapay zekâ araçlarını daha çok eğlence odaklı konumlandırırken, Google da Gemini üzerinden elde edilen bilgilerin mutlaka farklı kaynaklarla doğrulanmasını öneriyor. Tüm bu açıklamalar, yapay zekâ sistemlerinin henüz kesin ve güvenilir bir otorite olarak değerlendirilemeyeceğini ortaya koyuyor. Uzmanlara göre bilgi kirliliğini azaltmak için yapay zekâ algoritmalarında kaynak doğrulama ve denetim süreçlerinin daha güçlü ve sistematik hale getirilmesi gerekiyor.

Daha fazlası için haber içerikli makalelerimizi okuyabilirsiniz.